Erzielen Sie ein höheres Maß an Automatisierung und Geschäftswert

Die Integration eines LLM in Ihre Dokumentenverarbeitungs-Workflows bietet erhebliche betriebliche Vorteile und beschleunigt Ihren Weg zur intelligenten Automatisierung.

Effektivieren Sie die KI-Automatisierung mit zuverlässiger, präziser OCR-Technologie

Steigern Sie die Straight-Through-Dokumentenverarbeitung mithilfe datenbasierter Erkenntnisse

Integrieren Sie zuverlässige Document AI mit nur wenigen Zeilen Code in Ihre Automatisierungsworkflows

PROZESSVERSTÄNDNIS

PROZESSOPTIMIERUNG

Purpose-Built-AI für grenzenlose Automatisierung.

Starten Sie Ihre Automatisierung mit vorgefertigten KI-Extraktionsmodellen.

Lernen Sie die Mitwirkenden kennen, erkunden Sie Assets und vieles mehr.

Nach Industrie

Nach Geschäftsprozess

Nach Technologie

AUFBAUEN

Integrieren Sie erweiterte Texterkennungsfunktionen über die API in Ihre Anwendungen und in Ihre Workflows.

KI-fähige Dokumentendaten für kontextbezogene GenAI-Ausgabe mittels RAG.

LERNEN

Tauschen Sie sich mit Gleichgesinnten sowie mit erfahrenen OCR-, IDP- und KI-Experten aus.

Ein angesehener Titel, der an Entwickler verliehen wird, die außergewöhnliche Fachkenntnisse im Bereich ABBYY AI vorweisen können.

Entdecken

Einblicke

Implementierung

Integration von LLMs

Die Kombination einer speziell entwickelten Plattform für Intelligent Document Processing (IDP) mit der Flexibilität großer Sprachmodelle (LLMs) ermöglicht es Ihnen, über die Standarddatenextraktion hinauszugehen. Dieser hybride Ansatz unterstützt erweiterte Funktionen wie Zusammenfassungen, kontextbezogene Schlussfolgerungen und automatische Kommunikation. Durch die Integration eines LLM Ihrer Wahl in IDP können Sie Ihre bestehenden Dokumenten-Workflows erweitern, unstrukturierte Inhalte mit größerer Präzision bearbeiten und neue Effizienzpotenziale erschließen - und das alles in einer sicheren, kontrollierten und skalierbaren Umgebung.

Die Integration eines LLM in Ihre Dokumentenverarbeitungs-Workflows bietet erhebliche betriebliche Vorteile und beschleunigt Ihren Weg zur intelligenten Automatisierung.

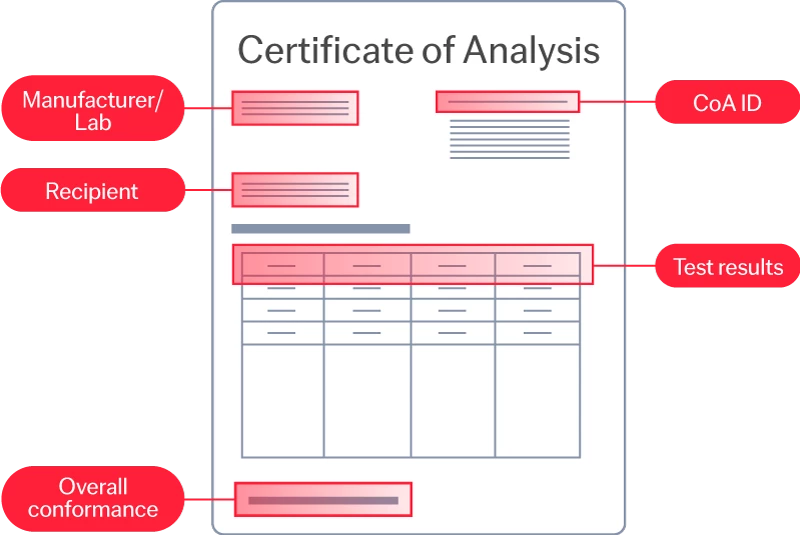

Gehen Sie über die einfache Datenextraktion hinaus. Verwenden Sie LLMs, um extrahierte Informationen zu interpretieren, Werte mit Vorschriften zu vergleichen oder Daten an branchenspezifische Codes und Klassifizierungen anzupassen.

Lösen Sie intelligente Folgeaktionen auf der Grundlage des Dokumenteninhalts aus. So kann ein LLM beispielsweise automatisch eine professionelle E-Mail an einen Lieferanten verfassen, wenn eine Rechnung Unstimmigkeiten enthält, die von der IDP-Plattform festgestellt wurden.

Verarbeiten Sie große Mengen an unstrukturiertem Text, indem Sie ein LLM prägnante Zusammenfassungen erstellen lassen. Dies ermöglicht Ihren Teams eine effizientere Auswertung von Bewerberprofilen, die Überprüfung von Rechtsklauseln oder die Analyse von Berichten.

Nutzen Sie die kreativen Fähigkeiten von LLMs für ein schnelles Prototyping und den Umgang mit sehr variablen oder unstrukturierten Inhalten, bei denen deterministische Regeln möglicherweise nicht ausreichen.

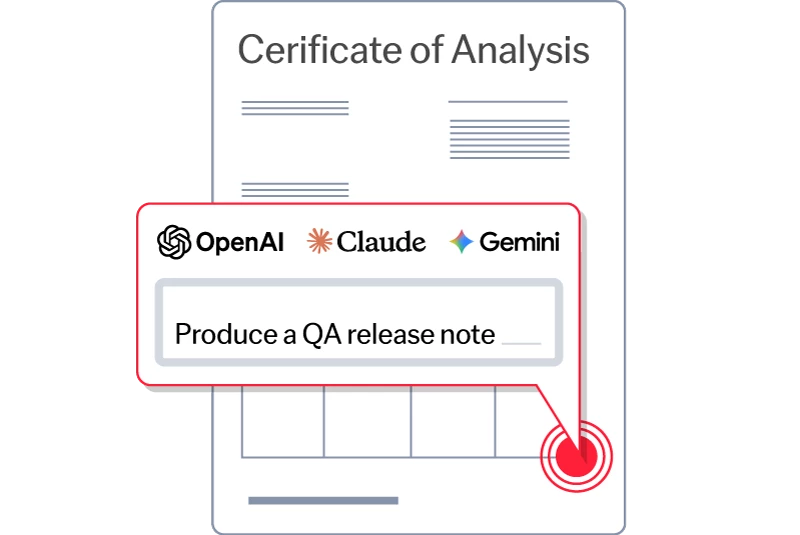

Die Integration eines LLM in Ihren Dokumentenverarbeitungs-Workflow von ABBYY ist unkompliziert. Unsere offene Architektur ermöglicht es Ihnen, Ihr eigenes LLM (OpenAI, Google Gemini, Anthropic Claude, Mistral AI usw.) einzubringen und es als Werkzeug zur Verbesserung von Extraktions-, Validierungs- und Nachbearbeitungsaufgaben zu nutzen, sodass Sie das Beste aus beiden Welten erhalten: die Struktur von IDP und die Flexibilität von generativer KI.

Nutzen Sie die speziell entwickelte ABBYY-Plattform, um eine erste Dokumentenklassifizierung, Segmentierung und Datenextraktion durchzuführen. So erhalten Sie eine strukturierte, genaue Grundlage für die Fakten Ihrer Dokumente.

Senden Sie die extrahierten, strukturierten Daten - oder bestimmte Segmente des Dokuments - über einen vorgefertigten Konnektor oder einen API-Aufruf an das von Ihnen gewählte LLM. Dieser gezielte Ansatz minimiert die Verwendung von Token und die Kosten und verringert gleichzeitig das Risiko von Halluzinationen.

Nutzen Sie den LLM-Output für nachgelagerte Aufgaben wie die Anreicherung von Daten, die Erstellung von Zusammenfassungen oder den Entwurf von Mitteilungen, die alle innerhalb Ihres automatisierten Workflows gesteuert werden.

Erfahren Sie, wie Ashling eine innovative Lösung mit ABBYY Vantage und GPT-4 Turbo entwickelt hat, um die Verarbeitung von 30.000 Mietverträgen pro Jahr für ein weltweites Fast-Food-Franchise-Unternehmen zu automatisieren - mit einer Genauigkeit von 82 %.

In diesem Leitfaden erläutern wir den Unterschied zwischen großen Sprachmodellen (LLMs) und kleinen Sprachmodellen (SLMs) und erklären, warum die Wahl des richtigen Modells zusammen mit hochwertigen Daten entscheidend ist, um das volle Potenzial von KI für Ihr Unternehmen zu erschließen.

Wenn LLMs und Document AI zusammen verwendet werden, gleichen die Stärken des einen die Einschränkungen des anderen aus. Wie das geht, erfahren Sie in diesem Artikel.

Erfahren Sie, wie Ashling eine innovative Lösung mit ABBYY Vantage und GPT-4 Turbo entwickelt hat, um die Verarbeitung von 30.000 Mietverträgen pro Jahr für ein weltweites Fast-Food-Franchise-Unternehmen zu automatisieren - mit einer Genauigkeit von 82 %.

In diesem Leitfaden erläutern wir den Unterschied zwischen großen Sprachmodellen (LLMs) und kleinen Sprachmodellen (SLMs) und erklären, warum die Wahl des richtigen Modells zusammen mit hochwertigen Daten entscheidend ist, um das volle Potenzial von KI für Ihr Unternehmen zu erschließen.

Wenn LLMs und Document AI zusammen verwendet werden, gleichen die Stärken des einen die Einschränkungen des anderen aus. Wie das geht, erfahren Sie in diesem Artikel.

Die Kombination von speziell entwickelter Document AI mit LLMs löst einen Multiplikatoreffekt aus – sie führt zu höherer Genauigkeit, intelligenterer Automatisierung und messbarem Geschäftswert.

Dieses Whitepaper untersucht die erheblichen Probleme, die sich aus der Verwendung von unstrukturierten Rohdaten für LLM-Anwendungen ergeben, und schlägt einen besseren Weg vor, um sicherzustellen, dass Ihre KI auf einer Grundlage von Klarheit und Genauigkeit aufbaut.

Dieser Artikel, der auch ein Demo-Video enthält, zeigt anhand eines Anwendungsfalls von ABBYY Vantage, wie diese Technologien in einer praktischen Anwendung, der Automatisierung von Versicherungsansprüchen, zusammenarbeiten können.

Die Kombination von speziell entwickelter Document AI mit LLMs löst einen Multiplikatoreffekt aus – sie führt zu höherer Genauigkeit, intelligenterer Automatisierung und messbarem Geschäftswert.

Dieses Whitepaper untersucht die erheblichen Probleme, die sich aus der Verwendung von unstrukturierten Rohdaten für LLM-Anwendungen ergeben, und schlägt einen besseren Weg vor, um sicherzustellen, dass Ihre KI auf einer Grundlage von Klarheit und Genauigkeit aufbaut.

Dieser Artikel, der auch ein Demo-Video enthält, zeigt anhand eines Anwendungsfalls von ABBYY Vantage, wie diese Technologien in einer praktischen Anwendung, der Automatisierung von Versicherungsansprüchen, zusammenarbeiten können.

Die Kosten für LLM-Inferenzen werden in der Regel pro Token berechnet. Durch den Einsatz einer IDP-Plattform zur Vorverarbeitung von Dokumenten und zur Extraktion relevanter Informationen senden Sie einen wesentlich kleineren, gezielten Input an das LLM. Dadurch werden der Tokenverbrauch und die Betriebskosten im Vergleich zum Einspeisen ganzer Dokumente in das Modell drastisch gesenkt. Außerdem haben Sie bei diesem Ansatz die volle Kontrolle über die an das LLM gesendeten Daten, was einen erheblichen Vorteil für den Datenschutz darstellt.

Die IDP-Plattform bietet die notwendige Infrastruktur für die Einhaltung der Unternehmensrichtlinien, einschließlich der Verfolgung der Datenreihenfolge, Prüfpfade und Versionskontrolle. Durch die Integration von LLMs in diesen geregelten Rahmen behalten Sie die volle Transparenz und Kontrolle über die Datenverarbeitung und stellen sicher, dass Ihre Arbeitsabläufe überprüfbar und mit den Branchenvorschriften konform sind.

Die ausschließliche Verwendung von allgemeinen LLMs birgt erhebliche Risiken, wie z. B. Datenhalluzinationen, Prompt-Fragilität (wenn Aktualisierungen Workflows unterbrechen), hohe Betriebskosten sowie fehlende Erklärbarkeit und Prüfpfade. Außerdem fehlt ihnen die Kerninfrastruktur für eine unternehmensgerechte Verarbeitung, wie z. B. Datenvalidierungsregeln und Human-in-the-Loop-Funktionen.

Branchenübergreifend kann die Integration von Large Language Models (LLMs) in die jeweiligen Dokumentenverarbeitungs-Workflows von Vorteil sein. LLMs erweitern die Möglichkeiten der Automatisierung, indem sie Aufgaben übernehmen, die logisches Denken und Verstehen erfordern und den Menschen von manuellen, zeitaufwändigen Schritten entlasten. Ob im Finanz-, Gesundheits-, Rechts- oder Versicherungswesen - LLMs bieten erweiterte Funktionen für die Dokumentenverarbeitung und ermöglichen eine schnellere Informationsverarbeitung und Entscheidungsfindung. Diese erweiterte Reichweite der Automatisierung eröffnet neue Möglichkeiten, wie Unternehmen ihre Prozesse optimieren können.

Große Sprachmodelle (LLMs) bieten zwar leistungsstarke Funktionen, ihre Hauptstärke liegt jedoch nicht in der genauen, sachbezogenen Datenextraktion. Die speziell entwickelte IDP-Technologie (Intelligent Document Processing) bietet eine wesentlich höhere Zuverlässigkeit bei der Extraktion strukturierter und unstrukturierter Daten aus Dokumenten. LLMs erweitern jedoch IDP erheblich, indem sie die Automatisierung auf Aufgaben ausdehnen, die ein tieferes Verständnis und logisches Denken erfordern, wie z. B. die Synthese von Informationen, die Erstellung von Zusammenfassungen oder die Handhabung komplexer bedingter Logik. Diese leistungsstarke Kombination aus IDP und LLMs steigert die Prozesseffizienz und liefert durch eine umfassendere Automatisierung einen höheren Geschäftswert.

Vereinbaren Sie einen Demo-Termin und erleben Sie, wie die intelligente Automatisierung von ABBYY Ihre Arbeitsweise verändern kann – für immer