In einem wichtigen Schritt hin zu einer transparenten und verantwortungsvollen KI hat ABBYY, ein weltweit führender Anbieter von intelligenter Prozessautomatisierung, ForHumanity Europe beauftragt, robuste organisatorische und technologische Maßnahmen zu ergreifen, um das EU-Gesetz über künstliche Intelligenz (EU AI Act bzw. EU-KI-Gesetz) einzuhalten.

Das Projekt mit ForHumanity umfasst zwei Phasen. Die erste ist die Entwicklung einer umfassenden Richtlinie zum KI-Risikomanagement in Übereinstimmung mit Artikel 9 des EU-KI-Gesetzes und die Einführung eines Registers zur KI-Risikobewertung, das die Überprüfbarkeit und Rückverfolgbarkeit der Verpflichtungen zur Einhaltung des EU-KI-Gesetzes nachweisen soll. Damit wird ein lebendiger Rahmen geschaffen, der die rechtliche, ethische und technische Einhaltung der KI-Governance sicherstellen soll.

Die Richtlinie zum KI-Risikomanagement von ABBYY legt Leitlinien und Prozesse fest, um mögliche Risiken im Zusammenhang mit künstlicher Intelligenz (KI) in Übereinstimmung mit den geltenden rechtlichen Rahmenbedingungen sowie den Rahmenbedingungen für das KI-Risikomanagement zu bestimmen und zu adressieren. Sie gewährleistet eine verantwortungsvolle Entwicklung, Einführung und Kontrolle von KI, um ethische, rechtliche und regulatorische Standards zu erfüllen und gleichzeitig die Risiken für den Einzelnen und die Gesellschaft zu minimieren. Die Richtlinie zielt darauf ab, das Vertrauen, die Transparenz und die Verantwortlichkeit in KI-Systeme zu fördern und gleichzeitig Innovationen zu unterstützen sowie potenziellen Schaden zu reduzieren.

Insbesondere verfolgt die Richtlinie zum KI-Risikomanagement von ABBYY folgende Ziele:

- Einhaltung der allgemein anerkannten Grundsätze des KI-Risikomanagements in Bezug auf Transparenz, Rechenschaftspflicht, Fairness, Schutz der Privatsphäre, Sicherheit und menschliche Aufsicht, wie in Kapitel III des EU-KI-Gesetzes vorgeschrieben.

- Einführung einer strengen Bewertung der Risikofaktoren, um potenzielle Risiken in Bezug auf ethische, technologische, sicherheitstechnische, rechtliche und operative Aspekte von KI zu ermitteln.

- Implementierung von Risikobewertungsprozessen und entsprechenden Kontrollen, die unter anderem die Datenverwaltung, die konzeptionelle Stabilität des Modells, die Zweckmäßigkeit bei der Bewertung der logischen Grundlagen der KI-Modelle, die Anpassung an die vorgesehene Anwendungsschnittstelle und die Integration in eine Anwendung, die Pipeline, die Einsatzumgebung, die Human-in-the-Loop-Mechanismen und die Ergebnisse des KI-Systems umfassen.

- Erstellung eines KI-Risikoregisters auf der Grundlage des Schweregrads, der Wahrscheinlichkeit und der Erkennbarkeit von KI-Risiken. Dies sorgt für die Überprüfbarkeit geeigneter Risikominderungsmaßnahmen und gewährleistet die Einhaltung von Vorschriften, die laufende Überwachung der Leistung und die rechtzeitige Reaktion auf Vorfälle oder Ausfälle.

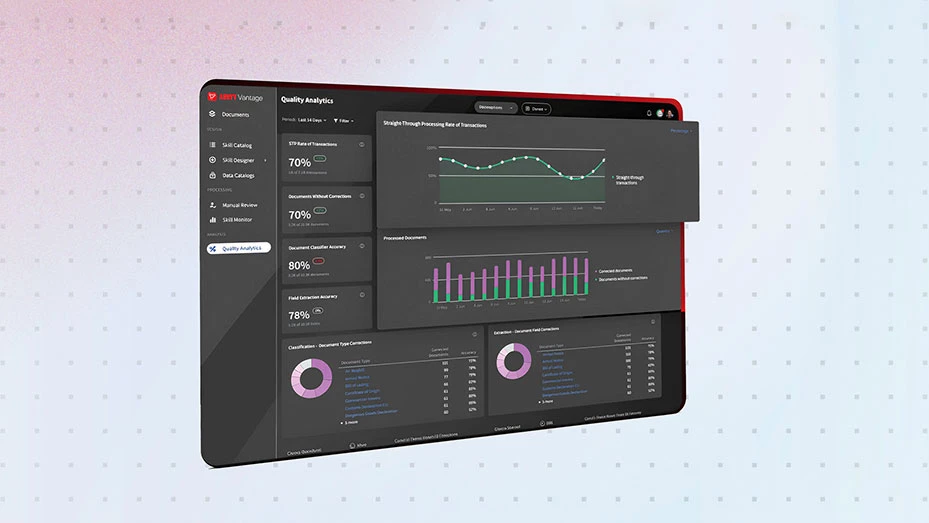

- Einrichtung einer kontinuierlichen Überwachung der KI-Systemleistung, der Risiken und der Compliance durch automatisierte und manuelle Prozesse.

- Detaillierte Delegation von Befugnissen für bestimmte ABBYY-Mitarbeiter, um die KI-Governance und die Überwachung der Verpflichtungen zur KI-Compliance von ABBYY über den gesamten Lebenszyklus des KI-Portfolios von ABBYY zu gewährleisten und eine Kultur der vertrauenswürdigen KI zu schaffen.

Die Richtlinie zum KI-Risikomanagement von ABBYY wurde entwickelt, um die Bereitstellung des marktführenden ABBYY-Portfolios für intelligente Prozessautomatisierung zukunftssicher zu machen. Unsere Kunden können sich auf eine pragmatische Grundlage verlassen, um sowohl die Einhaltung von Gesetzen als auch einen nachhaltigen KI-Erfolg zu erreichen.

Um mehr zu erfahren, besuchen Sie das ABBYY AI Trust Center, um sich für den Zugang zu registrieren und die Richtlinie zum KI-Risikomanagement von ABBYY einzusehen.

Sie können sich jetzt auf Abruf das Webinar vom 12. Juni ansehen, das von ForHumanity, Law+ Data und ABBYY veranstaltet wurde und sich auf das Zertifizierungsschema für das Modellrisikomanagement konzentriert, das die Leitlinie SR 11-7 der US-Notenbank für das Modellrisikomanagement ergänzen soll, indem es robuste und weltweit harmonisierte KI-Governance, Aufsicht und Rechenschaftspflicht für KI, algorithmische und autonome Systeme (AAA) integriert sowie Best Practices austauscht, um Risiken im Zusammenhang mit der Einhaltung von KI-Vorschriften zu verringern, wobei vorgegebene Compliance-Protokolle einzuhalten sind, um die Prüfbarkeit und Rückverfolgbarkeit von Compliance-Verpflichtungen zu gewährleisten.