Dans une avancée majeure vers une IA transparente et responsable, ABBYY, l’un des leaders mondiaux de l'automatisation intelligente des processus, a confié à ForHumanity Europe la mise en place de mesures organisationnelles et technologiques robustes afin de se conformer à la loi sur l'intelligence artificielle de l'Union européenne (Loi IA de l'UE).

Ce projet avec ForHumanity comprend deux phases. La première consiste à élaborer une politique complète de gestion des risques liés à l'IA (AI Risk Management Policy), conformément à l'article 9 de la Loi IA de l'UE, et à mettre en œuvre un registre d'évaluation des risques liés à l'IA. Ce registre vise à démontrer l'auditabilité et la traçabilité des obligations de conformité au titre de la Loi IA de l'UE. Cela crée un cadre évolutif pour le respect des exigences juridiques, éthiques et techniques de la gouvernance de l'IA.

La politique de gestion des risques liés à l'IA d'ABBYY pose les grands principes et définit des processus pour la gestion des risques liés à l'intelligence artificielle (IA), conformément aux cadres juridiques et de gestion des risques applicables. Elle garantit un développement, un déploiement et une gouvernance responsables de l'IA, conformes aux normes éthiques, juridiques et réglementaires, tout en atténuant les risques pour les individus et la société. Cette politique vise à favoriser la confiance, la transparence et la responsabilité dans les systèmes d'IA, tout en promouvant l'innovation et en minimisant les dommages potentiels.

En particulier, la politique ABBYY de gestion des risques liés à l'IA :

- Adhère aux principes généralement admis de la gestion des risques liés à l'IA : transparence, responsabilité, équité, confidentialité, sécurité et supervision humaine, conformément aux préconisations du chapitre III de la loi IA de l'UE.

- Instaure une évaluation rigoureuse des facteurs de risque liés à l'IA afin d'identifier les risques potentiels liés à l'IA sur les plans éthique, technologique, sécuritaire, juridique et opérationnel.

- Établit des processus applicables d'évaluation des risques et de contrôle, qui couvrent la gouvernance des données, la solidité conceptuelle des modèles, la pertinence de l'évaluation du fondement logique des modèles d'IA, l'adéquation avec l'interface et l'intégration des cas d'utilisation prévus, le pipeline, l'environnement de déploiement, les mécanismes d'intervention humaine et les résultats du système d'IA.

- Impose la création d'un registre des risques liés à l'IA basé sur la gravité, la probabilité et la détectabilité des niveaux de risque liés à l'IA, et assure l'auditabilité des mesures d'atténuation des risques appropriées, pour garantir la conformité réglementaire, la surveillance continue des performances et une réponse rapide aux incidents ou aux pannes.

- Établit une surveillance continue des performances, des risques et de la conformité du système d'IA grâce à des processus automatisés et des processus manuels.

- Crée une délégation de pouvoirs détaillée pour le personnel ABBYY désigné afin d'assurer la gouvernance et la supervision de l'IA et de respecter les obligations de conformité d'ABBYY tout au long du cycle de vie de son portefeuille de produits d'IA, afin également de favoriser une culture d'IA digne de confiance.

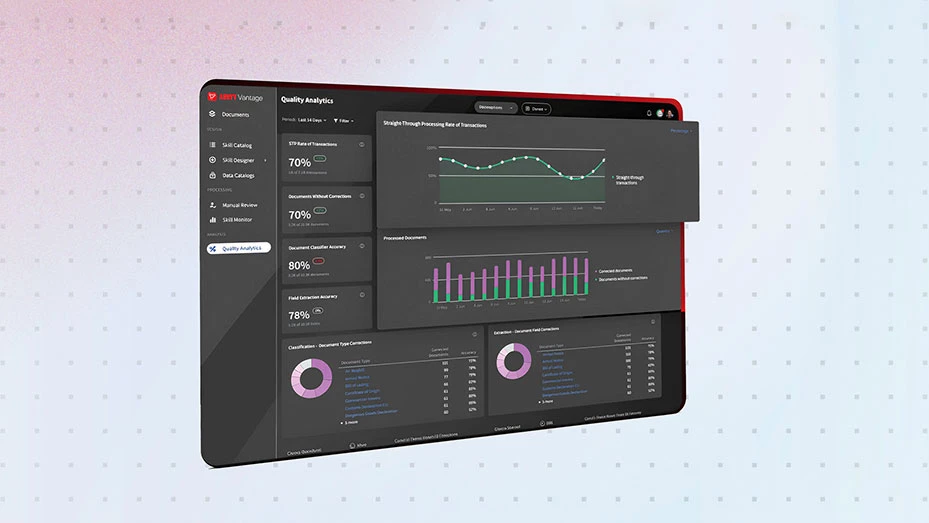

La politique ABBYY de gestion des risques liés à l'IA vise à pérenniser la distribution par ABBYY de son portefeuille de produits d'automatisation intelligente des processus, leaders sur le marché et auxquels les clients peuvent se fier comme base pragmatique pour atteindre tant la conformité légale que leur réussite durable en matière d'IA.

Pour en savoir plus, visitez l'ABBYY AI Trust Center (Centre de confiance en IA d'ABBYY) afin de vous inscrire et d'accéder à la Politique ABBYY de gestion des risques liés à l'IA.

Vous pouvez désormais visionner à la demande le webinaire du 12 juin, organisé par ForHumanity, Law+ Data et ABBYY, et consacré au programme de certification de la gestion des risques liés aux modèles. Ce programme vise à compléter les directives SR 11-7 de la Réserve fédérale américaine en matière de gestion des risques liés aux modèles, en intégrant une gouvernance, une supervision et une responsabilité de l'IA robustes et harmonisées à l'échelle internationale pour les systèmes IA, algorithmiques et autonomes (AAA). Il partage également les meilleures pratiques pour améliorer la conformité réglementaire en matière d’IA grâce aux protocoles de conformité prescrits, garantissant ainsi l'auditabilité et la traçabilité des obligations de conformité.