En un importante paso hacia una IA transparente y responsable, ABBYY, líder mundial en automatización inteligente de procesos, contrató a ForHumanity Europe para establecer sólidas medidas organizativas y tecnológicas encaminadas al cumplimiento del Reglamento de Inteligencia Artificial de la Unión Europea (Reglamento de IA de la UE).

El proyecto con ForHumanity consta de dos fases. La primera consiste en el desarrollo de una política integral de gestión de riesgos de la IA de conformidad con el artículo 9 del Reglamento de IA de la UE, así como en la aplicación de un registro de evaluación de riesgos de la IA diseñado para acreditar la auditabilidad y trazabilidad de las obligaciones de cumplimiento en virtud de dicho Reglamento. De este modo, se crea un marco dinámico que permite la buena gestión de la IA desde el punto de vista legal, ético y técnico.

La política de gestión de riesgos de IA de ABBYY establece directrices y procesos para gestionar los riesgos asociados a la inteligencia artificial (IA) de conformidad con los marcos legales y de gestión de riesgos de IA aplicables. Asimismo, garantiza el desarrollo, despliegue y gobernanza responsables de la IA para, así, ajustarse a las normas éticas, legales y reglamentarias, al tiempo que mitiga los riesgos para las personas y la sociedad. La política pretende fomentar la confianza, la transparencia y la responsabilidad en los sistemas de IA, a la vez que promueve la innovación y minimiza los daños potenciales.

En particular, la política de gestión de riesgos de IA de ABBYY:

- Se adhiere a los principios generalmente aceptados de gestión de riesgos de IA de transparencia, responsabilidad, imparcialidad, privacidad, seguridad y supervisión humana, y lo hace conforme a lo indicado en el capítulo III del Reglamento de IA de la UE.

- Establece una evaluación rigurosa de los factores de riesgo de la gestión de riesgos de la IA para identificar los posibles riesgos relacionados con la IA en las dimensiones ética, tecnológica, de seguridad, jurídica y operativa.

- Contempla procesos de evaluación de riesgos y controles aplicables que incluyen la gobernanza de datos, la solidez conceptual de los modelos, la adecuación a la finalidad en la evaluación del fundamento lógico de los modelos de IA, la alineación con la interfaz del caso de uso previsto y la integración, el proceso, el entorno de implementación, los mecanismos de intervención humana y los resultados del sistema de IA.

- Exige la creación de un registro de riesgos de IA basado en la gravedad, probabilidad y detectabilidad de los niveles de riesgo de IA, además de permitir que se auditen las medidas adecuadas de mitigación de riesgos, garantizando el cumplimiento normativo, la supervisión continua del rendimiento y la respuesta oportuna a incidentes o fallos.

- Establece una supervisión continua del rendimiento, los riesgos y el cumplimiento del sistema de IA mediante procesos automatizados y manuales.

- Crea una delegación detallada de autoridad para que el personal designado de ABBYY garantice la gobernanza y supervisión de la IA en relación con las obligaciones de cumplimiento de ABBYY en materia de IA a lo largo de todo el ciclo de vida de la cartera de IA de ABBYY y para que fomente una cultura de IA fiable.

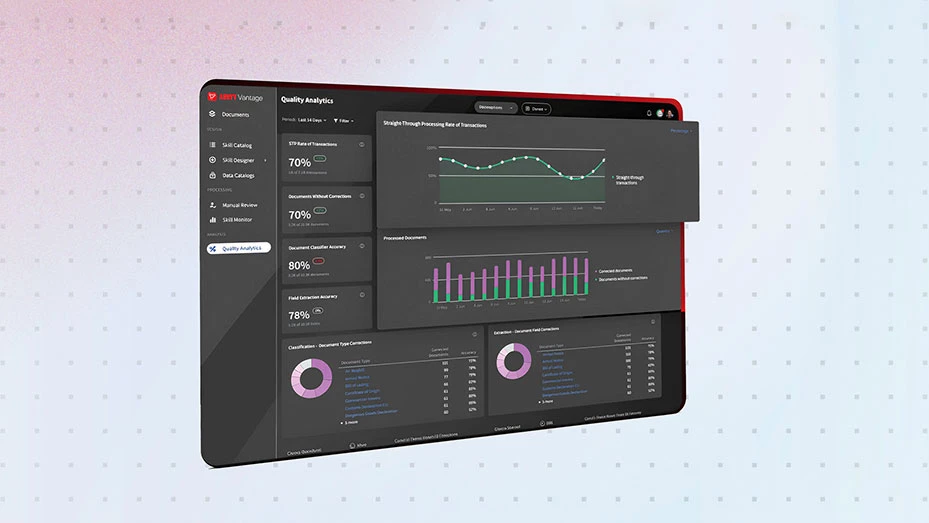

La política de gestión de riesgos de IA de ABBYY se ha concebido para garantizar el futuro de la cartera de automatización de procesos inteligentes de ABBYY, líder en el mercado, en la que nuestros clientes pueden confiar como base práctica para lograr tanto el cumplimiento legal como el éxito sostenible de la IA.

Para obtener más información, visite el Centro de confianza de IA de ABBYY para registrarse y consultar la política de gestión de riesgos de IA de ABBYY.

Ya puede ver a la carta el seminario web del 12 de junio organizado por ForHumanity, Law+ Data y ABBYY, centrado en el programa de certificación de gestión de riesgos de modelos concebido para complementar la guía SR 11-7 de gestión de riesgos de modelos de la Reserva Federal de Estados Unidos mediante la integración de una gobernanza, supervisión y responsabilidad sólidas y armonizadas a nivel mundial para los sistemas de IA, algorítmicos y autónomos, así como compartir las prácticas recomendadas para mitigar los riesgos asociados con el cumplimiento normativo de la IA con los protocolos de cumplimiento prescritos a fin de garantizar la auditabilidad y la trazabilidad de las obligaciones de cumplimiento normativo.